Snabb spridning av falska bilder och videor på sociala medier

Under lördagen delades ett flöde av AI-genererade bilder och videor som påstod visa Nicolás Maduró bli tillfångatagen av amerikanska styrkor. Dessa material spreds snabbt av offentliga personer och fick miljontals visningar över hela Europa. Kort efter att USA:s president Donald Trump meddelade om en ”storskalig attack” mot Venezuela, fylldes sociala medier i Europa med vilseledande bilder och videor av Madurós arrestation. Dessa inkluderade AI-alterade bilder, föråldrade videor som återanvänts som nyhetsmaterial, samt videoklipp utanför sitt sammanhang.

AI-genererade bilder av Maduro och deras spridning

På plattformar som TikTok, Instagram och X hade AI-genererade eller modifierade bilder, samt videos som inte hade något med verkligheten att göra, börjat dominera flödena. Flera av dessa hade miljonvisningar och delades av personer med offentlig profil, inklusive den tidigare amerikanska presidentkandidaten Donald Trump, Tesla-grundaren Elon Musk, den före detta brasilianske presidentsonen Flávio Bolsonaro samt den portugisiska högerextrema partiprofilen Chega. Vissa experter betraktade detta som ett av de första fallen där AI-genererade bilder av en så framträdande politisk figur skapades i realtid i samband med nyhetsrapportering.

Faktagranskning av bilderna från Maduro’s gripande

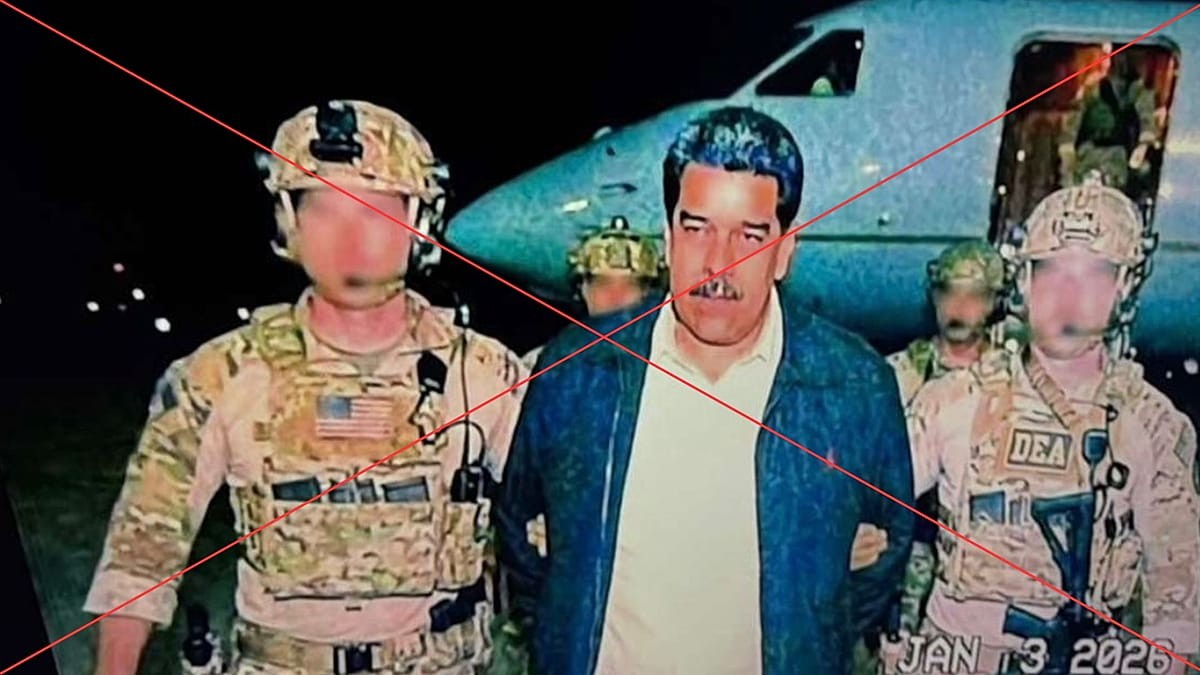

Den 3 januari genomförde särskilda USA-styrkor en snabb operation för att gripa Nicolás Maduro, tidigare ledare för Venezuela, och hans maka. Maduro åtalades för narkotikasmuggling, något han förnekar. Strax efter hans gripande började flera bilder av Maduro spridas. Euronews faktagranskningsteam, The Cube, hittade exempel på en specifik bild som delades på sociala medier på spanska, italienska, franska och polska.

En bild av Maduro när han lämnar ett flygplan delades av den portugisiska högerextrema partien Chega:s officiella konto samt av partiets grundare André Ventura och andra medlemmar. Flera digitala medier presenterade även bilden som ett verkligt foto. När forskare undersökte bilden med Googles verificationverktyg SynthID, upptäcktes vattenstämplar som visade att delar av bilden hade genererats eller redigerats med AI-teknologi.

Analys från Google Gemini indikerade att ”majoriteten av, eller hela, bilden hade genererats eller redigerats med Google AI”. Det tyska startupföretaget Detesia, specialiserat på deepfake-teknik, bekräftade detta genom att upptäcka betydande bevis för AI-generering. De konstaterade att den ursprungliga bilden hade inspirerat till liknande versioner med mindre spridning på sociala medier, vilka också visade tydliga tecken på AI-skapat innehåll, inklusive bilder där soldater har tre händer och bilder där Maduro är täckt av blod.

Den här bilden, som sannolikt är AI-genererad, hade miljontals visningar, inklusive en post på X på spanska som ensam hade 2,6 miljoner visningar. Enligt Tal Hagin, som är expert på informationskrigföring och mediekunnighet, gör snabba AI-innovationer det desto svårare att skilja äkta bilder från deepfakes.

Han förklarar att “vi är inte längre ett halvår bort från att kunna identifiera AI-bilder; vi är redan där.” I kölvattnet av Madurós gripande, poängterar Hagin att det råder brist på information, ofta utan bilder, vilket skapar ett tomrum som folk försöker fylla.

“Människor började ladda upp AI-genererade bilder av Maduro i förvar för att fylla tomrummet”, säger Hagin.

Misstänkta bilder av Maduro på flykt och their förfalskningar

En annan AI-genererad bild, som fått över 4,6 miljoner visningar, påstår visa Maduro sittande i ett militärtransportflyg i vita pyjamas. Plattformen NewsGuard, som övervakar informationspålitlighet, konstaterade att bilden tydligt visar tecken på AI-generering, bland annat dubbla passagerar-fönster i sätena. Bilderna strider dock mot tillgängliga bevis: Maduro transporterades ur Venezuela med helikopter till ett amerikanskt örlogsfartyg, inget av dessa flighter eller fartyg visar dubbla fönsterbilden.

Video och bilder av protester med AI-manipulation och kontextfel

Kort efter spridningen av falska bilder av Madurós arrestation, fylldes sociala medier med videor av personer som firade hans tillfångatagande. En av dessa, som Elon Musk delade och som visar venezolaner gråtande av glädje, har över 5,6 miljoner visningar. AI-teknologi kan spåras genom orealistiska människobevegelser, hudnyanser och missvisande registreringsskyltar på fordon.

Signaler från Venezuela visar att allmänhetens sinnelag är komplext. Vissa uttrycker glädje och hopp, medan andra uttrycker oro och osäkerhet kring vad en maktskifte kan innebära. Flera videoklipp föreställer protester med vilseledande bildtexter. En video på X, som samlade över en miljon visningar, visar en demonstration i Caracas i november 2025, trots att den bristfälliga bildkvaliteten och omständigheter pekar på att klippet är förfalskat.

En annan populär video visar en man på en balkong som håller upp en telefon inför en folkmassa, med påståendet att venezolanerna är extremt glada för att ha blivit av med Maduro tack vare amerikansk intervention. Experten Hagin påpekar att osynliga fel, såsom att fyrverkerierna tycks komma från bland folkmassan, ifrågasätter äktheten, liksom att videon visar tecken på digital manipulation.

Falska påståenden om USAs attack mot Chaves mausoleum

Förutom vilseledande bilder cirkulerar också falska påståenden om att USA hade bombat Hugo Chaves mausoleum. Dessa påståenden delades i flera språk och spreds till och med av den colombianske presidenten Guaidó. En bild som påstår visa mausoleum-bombningen visar sig vara AI-manipulation av en verklig 2013-bild, där skadan artificiellt tillfogats. Det Hugo Chavez-stiftelsen publicerade ett videoklipp som visar byggnaden oskadd, vilket tydde på att kommunikation kring den felaktiga påståendet var missvisande och att bilderna var förfalskningar.